AIガバナンスとは、AIの便益を最大化しつつ、リスクを受容可能な水準で管理する統制の仕組みのことです。

多くの企業がAI導入を進める中、特に大企業は情報漏洩などのセキュリティリスクに対応し、「提供者」としての責任を果たす必要があるため、経営層のコミットメントによる厳格なAIガバナンスが求められます。

しかし、企業規模が大きくなるほど、すべてのAI利用を完全に把握し管理することは困難になります。実効性のあるAIガバナンスをどのように構築していくべきか、多くの経営層や担当部門が直面する大きな課題となっています。

この記事では、ルールを厳格化するほど自社のコントロールの限界に気づかされるという実態を紐解きながら、「AI事業者ガイドライン第1.2版」のポイントと、大企業に焦点を当てたガバナンス構築のステップについて解説します。

LRMでは、長年の情報セキュリティ認証支援で培った確かな知見をもとに、専門チームがAIガバナンス構築を強力に伴走支援いたします。「AI方針の策定」から「リスクアセスメント」「ガイドラインの整備」に至るまでを一貫してサポートし、社内のAI活用を安全にスケールさせるための最適な体制づくりを実現します。ぜひお気軽にご相談ください。

AIガバナンスの基本定義と「AI推進法」施行による環境変化

AI時代において、企業のAI活用は避けて通れない道です。まずは、ガバナンスの基本的な定義と、国内における最新の法規制動向を理解します。

AIガバナンスとは何か?

2026年3月に総務省・経済産業省から公開された「AI 事業者ガイドライン 第1.2版」によると、AIガバナンスとは「AI の利活⽤によって⽣じるリスクをステークホルダーにとって受容可能な⽔準で管理しつつ、そこからもたらされる正のインパクト(便益)を最⼤化することを⽬的とする、ステークホルダーによる技術的、組織的、及び社会的システムの設計並びに運⽤」と定義されています。

企業がAIを活用する際、単にツールを導入して終わるのではなく、セキュリティ、プライバシー、倫理といった多角的な観点から適切なルールと運用体制を構築し、社会的な信頼を担保する仕組み全体を指します。

AIガバナンスと従来のガバナンスの違い

従来のコーポレートガバナンスが企業の不正防止や法令遵守を主目的とするのに対し、AIガバナンスはAI特有の「技術的・倫理的なリスク」の管理に焦点を当てる点が異なります。

AIのブラックボックス化による説明不能性に対するアカウンタビリティ(説明責任)の確保や、ハルシネーション(誤情報の出力)、差別的出力(バイアス)、著作権侵害といったAI固有のリスクを管理し、安全性や公平性を担保することが求められます。

なぜ今、大企業にAIガバナンスが必須なのか?

2025年6月の公布から9月の全面施行を迎えた「人工知能関連技術の研究開発及び活用の推進に関する法律(AI推進法)」や、同年12月策定の「適正性確保に関する指針」など、現在、国を挙げたAIのルール整備が急速に進んでいます。

これにより、自社サービスにAIを組み込む大企業は「提供者」としての重い法的・社会的責任を負うこととなり、自主的かつ能動的な適正性確保の取り組みが強く求められるようになりました。大企業でインシデントが発生した場合、社会インフラや顧客の財産に甚大な影響を及ぼすため、経営層のコミットメントを伴う厳格なガバナンスの構築が不可欠です。

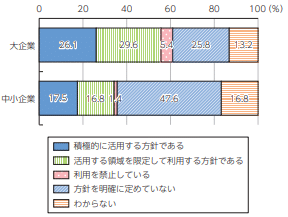

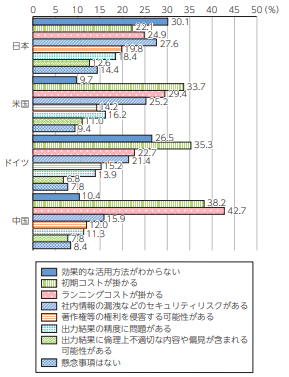

また、総務省の「令和7年版情報通信白書」によると、日本企業で生成AIの活用方針を策定しているのが中小企業が34.3%に対し、大企業は55.7%に及びます。一方で、日本企業における生成AIの導入に際しての懸念事項として「効果的な活用方法がわからない」が30.1%に次いで、「社内情報の漏えい等のセキュリティリスク」が27.6%と多く挙げられています。このデータからも、大企業においてAI活用を前向きに推進するためには、セキュリティリスクを適切に管理するガバナンス体制がいかに重要であるかが読み取れます。

生成AIの活用方針策定状況(企業規模別:日本)

引用元:総務省「令和7年版情報通信白書」(2025年7月)を加工して作成

生成AI導入に際しての懸念事項(国別)

引用元:総務省「令和7年版情報通信白書」(2025年7月)を加工して作成

企業を悩ませる「シャドーAI」と自律型「AIエージェント」の脅威

一般社団法人AIガバナンス協会(以下、AIガバナンス協会)が、国内でもAI利活用とリスク管理に真剣に取り組むガバナンス意識の高い先進企業※を対象に実施した「『いつの間にか』AIのリスク実態調査」をもとに、ルールを厳格化するほど自社のコントロールの限界に気づかされるという「AIガバナンスのパラドックス」について紐解いていきます。

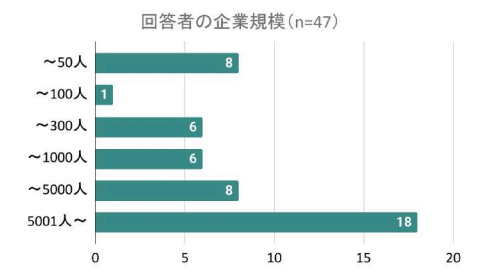

※企業規模については以下のようにスタートアップから従業員5000人超の大企業まで幅広い層が回答

引用元:一般社団法人AIガバナンス協会「「いつの間にか」AIのリスク実態調査」(2026年1月)を加工して作成

「いつの間にかAI」が入り込むリスクと「AIエージェント」の脅威

従業員の個人利用によるシャドーAIに加え、近年は自律的に動く「AIエージェント」が想定外の情報漏洩を引き起こす新たな脅威となっています。

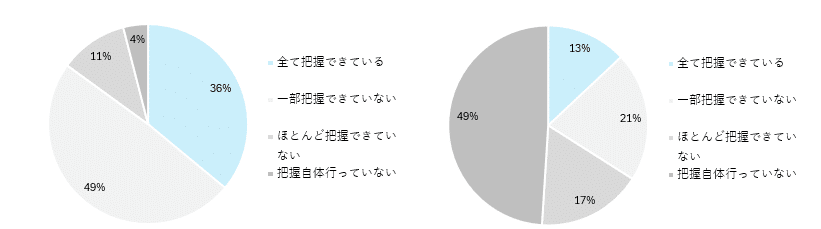

企業内に流入するAIのうち、従業員の個人利用や外部パートナー経由のAI利用は把握が難しく、「既存システムへの組み込まれたAIの利用やアップデート」について全て把握できているのは36%、「外部パートナーにおけるAI利用」においては13%に留まっており、個人のモラルに依存せざるを得ないのが実態です。

既存システムへの組み込み・アップデートAI 外部パートナーにおけるAI利用

引用元:一般社団法人AIガバナンス協会「「いつの間にか」AIのリスク実態調査」(2026年1月)を加工して作成

さらに、「AI事業者ガイドライン(第1.2版)」でも警鐘が鳴らされている通り、近年は外部システムやクラウドサービスと自律的に連携してタスクを実行する「AIエージェント」の導入が増加しています。この過程で脆弱性を突かれ、エージェントの挙動が不正に操作されることで、内部データが意図せず外部に送信されるといった複雑な漏洩リスクが生じています。

AIガバナンスのパラドックス:管理を強化するほど「見えなくなる」?

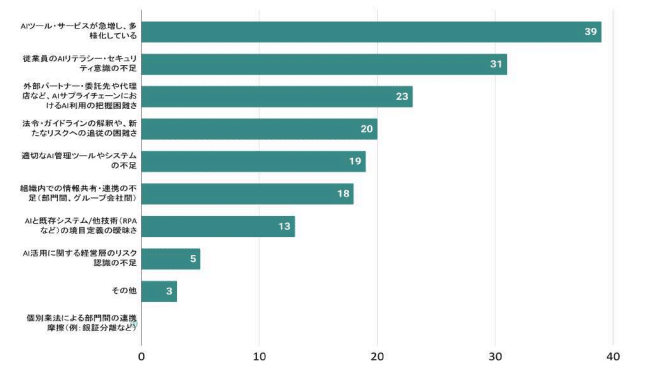

ガバナンス実践企業はAI利活用におけるリスクの芽を把握・管理する上での課題として、「AIツールの急増・多様化」や「従業員のAIリテラシー・セキュリティ知識の不足」という現実に直面し、すべてを網羅的に管理することの限界を痛感します。

しかし、「把握できていない」という課題認識は、管理能力の欠如ではなく、自社のコントロールの限界を正しく認識できている「成熟の証左」だと言えます。

この限界を理解して初めて、リスクの大きさに応じたメリハリのある対策や、本質的な課題解決に向き合っていくことができます。

AI利活用におけるリスクの芽を把握・管理する上での課題

引用元:一般社団法人AIガバナンス協会「「いつの間にか」AIのリスク実態調査」(2026年1月)を加工して作成

AIガバナンスを適切に機能させるためには、ルールの整備だけでなく、現場でAIを利用する従業員一人ひとりの意識改革が欠かせません。

LRMでは、セキュリティ教育のクラウドサービス『セキュリオ』を提供しています。最新の動向に合わせて随時更新される教育コンテンツにより、AI時代のリスクを前提とした従業員のAIリテラシーとセキュリティ意識の継続的な醸成にお役立ていただけます。

7日間無料でのトライアルもご用意しておりますので、ぜひ一度お試しください。

「完全管理の幻想」を捨て、リスクベース・アプローチによる選択と集中へ

AIガバナンス協会は同調査の結論として、社会のあらゆる場所にAIが実装されていく現代において「全てのAI利用を網羅的に把握・管理する」というアプローチの危うさに警鐘を鳴らしています。

企業が全件把握の完全管理に固執すれば、ガバナンス部門が疲弊するだけでなく、ビジネスのスピードを阻害し、結果としてルールが形骸化する「把握できているつもり」の危険な状態に陥りかねません。

そこで、大企業に求められているのが、「捕捉しきれないAIがある」という現実を受け入れた上で、AIごとのリスクのグラデーション(大きさや影響範囲)を見極め、対策の強度を柔軟に調整する「リスクベース・アプローチ」への転換です。

すべてのAI利用に一律の厳格な統制をかけるのではなく、自社にとっての「重大なAIリスク」を明確に定義し、そこに限られたリソースを集中させる「選択と集中」の実践が鍵となります。

「絶対に守るべき領域」を明確にして管理リソースを集中させることが、AI活用のスピードを落とさずに安全を確保する、現実的かつ実効性の高いガバナンスを実現させるために必要となります。

押さえるべき「AI事業者ガイドライン(第1.2版)」の要点

さらに大企業がリスクベースでAIガバナンスを構築する際のバイブルとなるのが、上記でも記載した経済産業省・総務省が公表している「AI事業者ガイドライン(第1.2版)」です。

AIに関わる3つの主体分類と「全てのAI関係者」に求められる国際指針

同ガイドラインでは、AIの事業活動を担う主体を「AI開発者」「AI提供者」「AI利用者」の3つに大別しています。さらに1.2版からは、G7で合意された「全てのAI関係者向けの広島プロセス国際指針」に即した行動が全事業者に強く求められています。

- AI開発者: AIモデルやAIシステム自体を研究・開発する事業者。データの収集・加工からアルゴリズムの設計、学習・検証などを担い、AIの根本的な安全性や公平性の確保に最も重い責任を持ちます。

- AI提供者: AIシステムを自社の製品やサービス、既存のシステム、ビジネスプロセス等に組み込んで、AI利用者に提供する事業者。AIが想定通りに安全に稼働するための運用支援や注意喚起を行う責任を負います。

- AI利用者: 提供されたAIシステムやサービスを、自社の事業活動や業務効率化のために利用する事業者。提供者が意図した範囲内で、適正かつ安全に利用する責任を持ちます。

大企業はプロジェクトごとに複数の役割を持つため、立場に応じた多角的なガバナンス体制が求められます。さらに、全てのAI関係者は、AIのライフサイクル全体にわたるリスクの特定・評価・軽減や、脆弱性の緩和、組織間での責任ある情報共有に取り組むことが国際的な基準として求められています。

また、AI開発者・AI提供者・AI利用者の3つの主体が各立ち位置に応じて、AIの特性に応じたリスクマネジメントシステムを構築・運用するための国際規格:AIMS(ISO/IEC 42001)について、以下の記事「AIMS(ISO/IEC 42001)とは概要やメリット・デメリットを解説」にて詳しく解説していますので、ご参考にしてください。

全主体が取り組むべき「10の共通の指針」

同ガイドラインでは、バリューチェーン全体で取り組むべき事項として以下の10の指針が整理されています。さらに大企業においては、これらをシステム要件や運用ルールという「実務」に翻訳して実装することが求められます。

- 人間中心:AIによる生成物であることを明示し、最終意思決定は人間が行うプロセスを設計する。

- 安全性:有害なプロンプトをブロックする「ガードレール機能」やキルスイッチを検討する。

- 公平性:学習データの偏りを監視し、AI単独で判断させないルールを徹底する。

- プライバシー保護:入力データがAIの再学習に利用されないよう「オプトアウト設定」を適用する。

- セキュリティ確保:プロンプトインジェクションに加え、AIエージェントの不正操作やフィジカルAIの乗っ取りといった最新の脅威に対する防御策を組み込む。

- 透明性:AIの回答根拠を提示し、システムの限界を明記して過信を防ぐ。

- アカウンタビリティ(説明責任):出力に至る経過を事後検証できるよう、プロンプト等のログを記録・保存する。

- 教育・リテラシー:業務でAIを利用する従業員に対し、意図せぬ情報漏えいの危険性等を継続的に教育する。

- 公正競争確保:他社の知的財産権や著作権を侵害しないデータ利用を徹底する。

- イノベーション:特定の言語モデルに過度に依存しない、相互運用性を確保したアーキテクチャを採用する。

経産省「AIガバナンス行動目標」にもとづく6つのステップ

経済産業省の「AI事業者ガイドライン(第1.2版)別添」で定義されている、事業者が具体的に実践すべき「AIガバナンス行動目標」に沿って、アジャイル・ガバナンスを構築するための6つのステップと実務への落とし込み方を解説します。

Step1:環境・リスク分析(行動目標1-1〜1-3)

AIの正負のインパクト、社会的受容、自社のAI習熟度を正確に把握することから始まります。

- 行動目標1-1(便益とリスクの理解):AIシステムから得られる便益だけでなく、意図しないリスクがあることを具体的に理解し、経営層に報告・共有して適時に更新する。

- 行動目標1-2(AIの社会的な受容の理解):本本格的な提供・利用に先立ち、ステークホルダーの意見にもとづいて社会的な受容の現状を理解する。

- 行動目標1-3(自社のAI習熟度の理解):自社の開発・運用経験や、従業員のリテラシー等にもとづいて、自社の「AI習熟度」を客観的に評価する。

Step2:ゴール設定(行動目標2-1)

自社の存在意義や経営ビジョンと整合した「AIポリシー」を設定します。

- 行動目標2-1(AIガバナンス・ゴールの設定):自社の存在意義や経営ビジョンと整合した「AIポリシー」等のゴールを設定し、公開する。

Step3:システムデザインと運用体制の構築(行動目標3-1〜3-4)

設定したゴールと実態のギャップを評価し、社内外の協力体制やインシデント対応策を組み込みます。

- 行動目標3-1(ゴール及び乖離の評価及び乖離対応の必須化):AIガバナンス・ゴールからの乖離を評価し、受容できないリスクがある場合は開発・運用の在り方を再考するプロセスを設ける。

- 行動目標3-2(AIマネジメントの人材のリテラシー向上):経営層から担当者に至るまで、役割に応じたAI倫理・技術に関する研修を実施する。

- 行動目標3-3(各主体間・部門間の協力によるAIマネジメント強化):複数事業者間でAI運用上の課題や必要な情報を積極的に共有する体制を作る。

- 行動目標3-4(予防・早期対応による利用者のインシデント関連の負担軽減):インシデントの予防と、発生時の被害拡大防止・早期対応計画を事前に策定する。

Step4:運用とアカウンタビリティの確保(行動目標4-1〜4-3)

AIの運用状況を継続的にモニタリングし、外部に対して説明可能な状態(透明性)を維持します。

- 行動目標4-1(AIマネジメントシステム運用状況の説明可能な状態の確保):乖離評価プロセスの実施状況など、マネジメントシステム全体の運用状況を対外的に説明可能な状態にする

- 行動目標4-2(個々のAIシステム運用状況の説明可能な状態の確保):個別のAIシステムの運用状況をモニタリングし、PDCAを回しながら記録する。

- 行動目標4-3(AIガバナンスの実践状況の積極的な開示の検討):AIガバナンスへの取組を「非財務情報」等として積極的に開示する。

Step5:評価と第三者視点の導入(行動目標5-1〜5-2)

独立した専門家やステークホルダーの意見を取り入れ、マネジメントシステムの客観的な妥当性を検証します。

- 行動目標5-1(AIマネジメントシステムの機能の検証):独立した専門性を有する者に、マネジメントシステムが適切に機能しているか評価させる。

- 行動目標5-2(社外ステークホルダーの意見の検討):株主、消費者、有識者など多様なステークホルダーから運用に対する意見を求める機会を設ける。

Step6:環境・リスクの再分析(アジャイル・ガバナンス)(行動目標6-1)

技術や法規制の変化に合わせて、ルールをアジャイル(機敏)にアップデートします。

AI技術の進化は早いため、一度作った硬直的なルールに固執してはいけません。自社内でヒヤリ・ハット事例が発生した際や、新たな国際規制が発表された際など、外部環境の変化をトリガーとして適時にリスク分析をやり直し、ガイドラインをアップデートし続ける姿勢(アジャイル・ガバナンス)が不可欠です。

- 行動目標6-1(行動目標1-1~1-3の適時の再実施):新技術の出現や規制変更などの外部環境の変化に合わせて、Step1の環境・リスク分析を適時に再実施する。

よくある質問(FAQ)

Q. AIガバナンス構築はどこから手をつけるべきですか?

A. まずは自社の「AI習熟度(行動目標1-3)」を評価し、スモールスタートから始めることが推奨されます。また、AIガバナンス協会が提供する自己診断ツール等を活用し、自社の成熟度や強み・弱みを客観的に把握することも有効です。

Q. 中小企業と大企業でAIガバナンスの対応に違いはありますか?

A. 基本的な指針は共通ですが、大企業は取り扱うデータ量や社会への影響度が大きく、自社製品にAIを組み込む「AI提供者」としての広範な説明責任や、サプライチェーン全体を巻き込んだより高度なリスク管理体制(行動目標3-3の事業者間連携など)が強く求められます。

まとめ:AIガバナンスの実効性は自社の限界を知ることから始まる

ルールや専門組織を整備し、ガバナンスを真剣に実践している企業ほど、「自社のAI利用を完全に把握できていない」という逆転現象(AIガバナンスのパラドックス)に直面します。

しかし、シャドーAIやAIエージェントの流入など、管理の限界を正しく認識することこそが、AIガバナンスにおける「成熟の証左」です。この限界を理解して初めて、リスクの大きさに応じたメリハリのある管理(リスクベース・アプローチ)や、実効性のあるルールの整備、そしてそれを運用し続ける体制の構築へと踏み出すことができます。

とはいえ、自社のみで全社的な体制構築や、最新のガイドラインに準拠したルール策定を進めるのは容易ではありません。ハードルが高いと感じられた場合は、専門家による「AIガバナンス診断」や「ルール策定支援コンサルティング」の活用をぜひご検討ください。

LRMではAIガバナンスに必要な全要素を、体系的にサポートするコンサルティングサービスを提供いたします。貴社の状況に合わせた最適なアプローチをご提案いたしますので、ぜひお気軽にご相談ください。